Innehåll

- Vad är Generative Engine Optimization?

- Varför GEO blir ett krav, inte ett val

- Hur AI-modeller väljer källor

- Rankingfaktorer för LLMs enligt studier

- Brand Mentions och AI

- Så skapar du GEO-optimerat innehåll

- Så arbetar Viseo med GEO

- Vanliga misstag inom GEO

- Checklista för GEO-optimering

- Relationen mellan SEO och GEO

- Vanliga frågor & svar

AI optimering 2026 – Så syns du i AI söket med hjälp av GEO

Axel Hansson

22 november, 2025

Generative Engine Optimization (GEO) handlar om att göra innehåll lätt för AI-modeller att förstå och använda när de svarar på frågor. När någon söker i ChatGPT, Gemini, Claude eller Perplexity väljer modellen bara några få webbsidor, och den prioriterar sådant som är tydligt skrivet och enkelt att tolka.

Det gör att struktur och tydlighet blir viktigare än länkar och traditionella auktoritetssignaler. Rubriker som speglar vanliga frågor, korta stycken och raka förklaringar gör det lättare för modellerna att ta till sig innehållet. Studier visar att sidor som täcker ett ämne ordentligt, har tydliga rubriker och håller informationen samlad och logisk presterar bättre i AI-svar.

I den här guiden får du konkreta åtgärder som visat sig fungera när man optimerar för AI och som ökar chansen att ditt innehåll syns i AI-svar under 2026.

Vad är Generative Engine Optimization?

Generative Engine Optimization, eller GEO, handlar om att skriva innehåll som AI-modeller lätt kan använda när de svarar på frågor. När någon söker i ChatGPT, Gemini, Claude eller Perplexity hämtar modellen bara ett fåtal webbsidor, och syftet med GEO är att ditt innehåll ska vara ett av alternativen.

I traditionell SEO kan innehåll vara utspritt eller byggt med långa inledningar och marknadsförande delar. För AI-modeller fungerar det sämre. De letar efter enkla förklaringar, tydliga rubriker och raka svar som kommer tidigt i texten.

Hur GEO skiljer sig från vanlig SEO

SEO handlar om att synas i ett sökresultat. GEO handlar mer om hur lätt informationen går att förstå. Modellerna tittar inte på länkar och auktoritet utan på struktur och tydlighet. Rubriker som speglar faktiska frågor och korta stycken gör det enklare för modellerna att avgöra vad texten innehåller.

En sida som håller allt samlat och förklarar ämnet direkt fungerar bättre än material som kräver att man läser långt för att hitta svaret. GEO bygger därför på enkla, raka avsnitt där det viktigaste kommer tidigt och där läsaren snabbt förstår vad texten vill säga.

Varför GEO blir ett krav, inte ett val

Förändringen i hur människor söker information är tydlig. Istället för att öppna Google och jämföra olika källor vänder sig fler användare direkt till AI-verktyg för att få ett sammanfattat svar. Det här beteendet påverkar trafiken till webbplatser kraftigt.

När en modell levererar ett komplett svar direkt i chattgränssnittet finns ingen anledning för användaren att klicka vidare. Synlighet handlar inte längre enbart om att vara synlig i SERP - det handlar om att vara den källa modellen refererar till.

Språkmodeller används idag för allt från snabba faktakontroller till djupare research. De ersätter inte enbart "hur-frågor" utan även jämförelser, rekommendationer och beslutsunderlag.

När en användare frågar "vilken CRM passar ett litet företag?" förväntar de sig inte längre en lista med länkar - de förväntar sig ett svar med kontext och rekommendationer.

Synlighet handlar om att vara en källa

När modeller levererar färdiga svar blir antalet refererade webbsidor få. I många fall nämns endast 2-4 källor per svar, och dessa väljs baserat på hur lätt modellen kan extrahera relevant information.

Det här är en grundläggande skillnad mot SEO. I sökmotoroptimering kan en webbplats dra nytta av att ranka på position 5-10 och ändå få klick. I GEO-sammanhang finns ingen "andra sida" - antingen är din webbplats med bland källorna eller så syns den inte alls.

Hur AI-modeller väljer källor

AI-modeller fungerar inte som traditionella sökmotorer. De tittar inte på länkar, de räknar inte auktoritet och de använder inte klassiska SEO-signaler. I stället utgår de från hur informationen är uppbyggd och hur enkelt den går att förstå.

När en modell får en fråga letar den efter texter som ger raka svar. Den tolkar rubriker, stycken och hur innehållet är organiserat. Tydliga definitioner, kortare block och förklaringar som kommer tidigt gör det enklare för modellen att se vad texten handlar om.

Arbetssättet liknar hur en person gör research

Först tittar man på vilka källor som verkar relevanta, sedan plockar man ut det viktigaste och sätter ihop svaret efter det. Skillnaden är att modellen gör det snabbt och behöver att informationen är tydligt presenterad. Den läser inte mellan raderna, så allt som är viktigt behöver uttryckas på ett rakt och enkelt sätt.

Se hur din hemsida presterar i AI-sök

Få en snabb analys av hur modeller som ChatGPT, Gemini och Perplexity tolkar ditt innehåll.

Information retrieval cost

Ett begrepp som blivit allt mer relevant är "information retrieval cost". Det beskriver hur mycket "arbete" en modell måste lägga ner för att extrahera användbar information från en text.

Om din artikel har långa stycken utan rubriker, om definitioner är begravda mitt i texten eller om informationen är utspridd över flera undersidor blir retrieval cost hög. Modellen kan tekniskt sett hitta informationen, men den väljer hellre en källa där svaret finns lättillgängligt redan i de första styckena.

Vad som sänker information retrieval cost:

- Tydliga rubriker som beskriver innehållet

- Korta block på 3-5 rader

- Faktablock som kan lyftas rakt av

- Definitioner tidigt i texten

- Listor och punkter där det passar

- Tydlig intern struktur

Vad som ökar information retrieval cost:

- Långa stycken utan pauser ("wall of text")

- Otydliga eller hoppiga resonemang

- Rubriker som låter kreativa men inte beskriver innehållet

- Struktur som är svår att följa

- Fakta som sprids ut över flera delar istället för att samlas

- Inledningar som tar lång tid innan de kommer till saken

För dig som skriver innehåll betyder det att otydliga rubriker, långa stycken och onödiga ord gör det svårare för modellerna att förstå texten. Ju mer rakt och tydligt allt är, desto större chans att innehållet faktiskt används i deras svar.

Varför struktur slår kreativitet

AI-modeller väljer texter där informationen är tydlig och lätt att förstå. De använder inte PageRank eller länksignaler, utan lägger större vikt vid hur informationen är uppbyggd och hur enkelt den går att tolka.

En kreativt skriven artikel med metaforer och berättande inledningar kan vara engagerande för en mänsklig läsare - men den är svår för en modell att tolka. Modellen söker efter mönster: "Här är en definition", "Här är en lista med egenskaper", "Här är ett konkret exempel".

Det betyder inte att texter behöver vara torra eller tråkiga. De ska fortfarande vara läsbara och ge värde för människor. Men strukturen behöver vara tydlig och logisk, så att både läsare och modeller snabbt förstår vad avsnittet handlar om. En bra text kan vara både enkel, tydlig och välskriven utan att förlora sin ton.

Rankingfaktorer för LLMs enligt studier

Studier visar vilka delar av en sida som påverkar hur AI-modeller väljer innehåll när de svarar på frågor. Mönstret skiljer sig från traditionell SEO och pekar tydligt på vad som har störst betydelse.

Här är de viktigaste faktorerna, ordnade efter hur mycket de brukar påverka:

| Faktor | Beskrivning |

|---|---|

| Topical coverage | Sidor som täcker ämnet ordentligt och samlat används oftare av modeller. |

| Domäntrafik | Webbplatser med mycket faktisk trafik uppfattas som mer tillförlitliga. |

| Titlar och URL:er | Klara titlar och tydliga URL:er gör att modellen snabbare förstår sidans innehåll. |

| Tydlig formatering | Markerade ord, listor och tydliga faktarader gör viktig information lätt att hitta. |

| Rubriker (H1–H6) | Tydliga rubriker som följer ämnets logik hjälper modellen att tolka texten. |

| Textlängd och variation | Längre texter med bra ämnesbredd och naturlig variation fungerar bättre. |

| Laddningstid | Påverkar svagt, men bör ändå vara rimlig. |

| Schema markup | Ger ingen tydlig effekt i AI-svar. |

| DR och länkar | Har låg betydelse jämfört med traditionell SEO. |

Brett innehåll ger bättre resultat

Sidor som går igenom ett ämne ordentligt och tar upp flera närliggande frågor väljs oftare av AI-modeller. Det här kallas topical coverage, och innebär att modellen hittar allt den behöver på samma sida istället för att leta i flera korta artiklar.

En text som bara svarar på en enda fråga kan fungera bra i Google, men AI-modeller prioriterar bredare innehåll. De söker efter förklaringar, sammanhang och relaterade delar av ämnet, inte bara ett kort svar.

Om någon frågar "vad är content marketing?" vill modellen se mer än en definition. Den vill hitta information om hur det används, olika arbetssätt och hur det skiljer sig från annan marknadsföring.

Topical coverage handlar därför om att samla de viktigaste delarna av ett ämne på en och samma sida. Texten behöver inte vara lång, men den ska täcka det användare brukar undra över.

När allt finns samlat på ett ställe blir sidan enklare för AI att använda än flera små artiklar där varje del ligger utspridd.

Så skriver du rubriker som AI kan tolka

Rubriker hjälper AI-modeller att förstå vad en sida handlar om. Varje H2 och H3 ses som ett eget avsnitt som modellen kopplar till helheten. Ju tydligare rubriken är, desto lättare hittar modellen rätt del av innehållet.

Så här fungerar rubriker bäst:

- H1 ska beskriva huvudämnet klart och tydligt

- H2 ska ta upp frågor eller delar av ämnet som användare brukar undra över

- H3 används när ett avsnitt behöver delas upp i mindre delar

- rubriker ska vara informativa, inte kreativa eller "säljiga"

- variation i språk fungerar bättre än upprepningar

- rubriker som formuleras som frågor är ofta enklare för modeller att tolka

Huvudrubriken behöver direkt tala om vad texten handlar om. "Vad är Generative Engine Optimization?" är ett tydligt exempel. En rubrik som "Framtidens SEO är här" säger nästan ingenting.

Samma sak gäller rubriker som "Tre enkla steg till framgång". Modellen ser inte vad stegen handlar om. "Tre steg för att komma igång med GEO" är ett bättre alternativ eftersom den berättar vad avsnittet faktiskt går igenom.

Bold och tydlig styckeindelning

Bold kan användas för att lyfta fram det som är extra viktigt i en text. Det handlar inte om att markera mycket, utan att markera det som läsaren och modellen behöver se direkt. När viktiga ord, siffror eller definitioner sticker ut blir texten enklare att läsa och lättare för en AI-modell att tolka.

Exempel som är bra att fetmarkera:

- förklaringar av ett ord första gången det nämns

- viktiga termer som återkommer längre fram

- tal, procent och andra fasta värden

- steg i en process när något ska göras i ordning

Undvik att fetmarkera:

- hela meningar

- ord som inte tillför något

- markeringar som gör texten tung eller svårläst

En tydlig styckeindelning gör stor skillnad.

Korta stycken på tre till fem rader är lättare att ta in både för läsaren och för AI-modeller. Varje stycke bör ha en tydlig poäng så det framgår direkt vad som är viktigt. Det gör texten lättare att använda och ökar chansen att modeller plockar ut rätt dela

URL:er och titlar

En tydlig URL gör det enklare för AI-modeller att förstå vad sidan handlar om redan innan de läser texten. Klara och beskrivande URL:er fungerar bäst.

Exempel som fungerar bra:

- viseo.se/geo-optimering

- viseo.se/guide/generative-engine-optimization

- viseo.se/seo/llm-optimering

Exempel som fungerar sämre:

- viseo.se/blogg/post-2024-11-22

- viseo.se/artiklar/tips-och-trix

- viseo.se/p=12345

URL:en ska vara kort, tydlig och gärna innehålla ämnet. Undvik mappar och parametrar som inte säger något om innehållet.

Titeln fungerar på samma sätt. Den ska snabbt förklara vad sidan handlar om, utan onödiga formuleringar eller försök att låta kreativ.

Bra exempel på titlar:

- "Vad är Generative Engine Optimization?"

- "GEO-optimering: Så fungerar det i praktiken"

- "Guide till GEO 2025: Optimera innehåll för AI-modeller"

Dåliga exempel:

- "Framtidens SEO är här" (säger inget om vad sidan faktiskt innehåller)

- "Maxa din synlighet online" (för brett och otydligt)

- "Så lyckas du" (helt utan ämne)

Tydliga titlar gör det enklare för både människor och AI-modeller att se vad sidan handlar om och ökar chansen att innehållet används som källa.

Domäntrafik viktigare än länkar

AI-modeller verkar väga faktisk trafik högre än mängden länkar. Webbplatser som många faktiskt besöker får ofta starkare korrelation med att användas som källa.

Ett tydligt mönster är att Domain Rating (DR) har svag korrelation med hur ofta en sida citeras av AI-modeller. Däremot har verklig trafik en tydlig korrelation med synlighet i AI-svar.

Det innebär att en webbplats med mycket trafik men låg DR kan prestera bättre i GEO än en sida som har många backlinks men få besökare.

En rimlig förklaring är att trafik visar att innehållet används och upplevs som relevant. Det blir en signal som modellerna tolkar som att informationen är mer pålitlig.

AI-genererat innehåll

AI-skrivet innehåll påverkar inte hur modeller väljer källor. Det viktiga är att texten är tydlig och strukturerad så att modellen snabbt förstår vad som är relevant.

Om innehållet har klara rubriker, korta stycken och täcker ämnet ordentligt spelar det ingen roll hur det har producerats. Modellen bedömer bara hur lätt det är att hitta svaren, inte om texten är skriven för hand eller med hjälp av AI.

Vad som fortfarande fungerar

Grundläggande on-page-principer är inte föråldrade - de är grunden för GEO.

- Styckeindelning - Text strukturerad i tydliga stycken med en tanke per avsnitt gör det enkelt för modeller att hitta specifik information.

- Hur ofta sökord nämns - Det som spelar störst roll är hur många gånger viktiga sökord finns med i texten. Modellerna bryr sig mindre om keyword density. Det är alltså själva antalet gånger ett ord dyker upp som väger tyngst. Synonymer och närliggande uttryck gör dessutom att modellen lättare ser bredden i ämnet.

- Längre text - Texter mellan 1500-3000 ord presterar bäst, förutsatt att varje del tillför värde. Längd för sakens skull fungerar inte - bredden i täckningen är det som räknas.

- Semantisk bredd - Att inkludera relaterade koncept, förklara sammanhang och länka ihop olika aspekter av ett ämne gör texten mer komplett och därmed mer citationsvärd.

- Ren HTML-struktur – Korrekt användning av HTML-taggar hjälper modeller att förstå informationshierarkin. En rubrik som ska vara en h2 ska skrivas som en h2, inte som ett stycke med större textstorlek.

GEO ersätter inte traditionell SEO - det bygger vidare på samma grund. Skillnaden är att GEO ställer högre krav på precision, struktur och ämnesbredd.

Schema markup och laddningstider

Schema markup påverkar inte hur AI-modeller väljer innehåll. Det är gjort för sökmotorer och styr hur en sida visas i Google, men modeller som ChatGPT och Gemini använder inte schema när de letar efter information. De läser bara själva texten.

Det betyder inte att schema är onödigt. Det är bra för vanlig SEO, men det är inte något som förbättrar synligheten i AI-svar. Därför ska fokus ligga på innehållet och hur det är strukturerat, inte på schema.

Samma mönster syns för laddningstid. Studier visar att både sidans hastighet och TTFB har svag påverkan på om en modell använder innehållet eller inte. Modeller upplever inte "långsam laddning" som en användare gör. När en modell läser texten är sidan redan hämtad i bakgrunden.

Kort sagt: schema, laddningstid och TTFB är bra att hålla i ordning för vanlig SEO, men de påverkar AI-modellers val av källor mycket lite. Det som spelar roll i GEO är innehållet och hur tydligt det presenteras.

Brand Mentions och AI

AI-modeller arbetar inte med PageRank, men de använder "entity frequency". Ju oftare ditt företag nämns i relevanta sammanhang, desto större sannolikhet att modellen kopplar ditt varumärke till ämnet.

Språkmodeller tränas på enorma mängder text från webben. Under träningen bygger de upp en förståelse för vilka entiteter (företag, personer, begrepp, platser) som är kopplade till vilka ämnesområden.

Om ett varumärke konsekvent dyker upp i texter som handlar om ett specifikt ämne, lär sig modellen att det varumärket är relevant för den typen av frågor.

Det här handlar inte om länkkraft.

Det viktiga är inte hur många backlinks en webbplats har, utan att företagets namn nämns i relevanta sammanhang. Om ett företag nämns i en text som beskriver ett område där det ses som kunnigt, ökar det företagets entity frequency även utan länk.

Brand mentions fyller tre funktioner:

- Förstärker en entitet i modellens minne - Varje gång ett varumärke nämns i relevant kontext förstärks kopplingen mellan företaget och ämnesområdet.

- Kopplar ett varumärke till ett specifikt ämnesområde - Om ett företag nämns i artiklar om content marketing, SEO och digital strategi kommer modellen att associera företaget med dessa områden.

- Ökar sannolikheten att modellen väljer företaget som källa - När modellen ska välja källor prioriterar den entiteter den "känner igen" som relevanta för ämnet.

Hur du bygger brand mentions

Brand mentions handlar om att få företagsnamnet att synas i sammanhang som är relevanta för det område du arbetar inom. Det viktiga är att namnet dyker upp där ämnet faktiskt diskuteras och där innehållet har tydlig koppling till ert expertområde.

Bra sätt att göra det på:

- Gästinlägg och branschartiklar – Medverka på webbplatser som din målgrupp redan använder. När företaget nämns i relevanta sammanhang blir kopplingen till ämnet tydligare.

- Sammanställningar och listor – Artiklar som "bästa verktygen ..." eller liknande är bra tillfällen att bli nämnd. Varje sådan nämning stärker modellen i hur den kopplar företaget till området.

- Citat och expertkommentarer – Att medverka i artiklar, poddar eller intervjuer gör att företaget syns i naturliga diskussioner där ämnet redan står i fokus.

- Rapporter och studier – Att bidra till eller nämnas i branschrapporter ger lång livslängd, eftersom sådant material ofta sprids och används under lång tid.

Det som spelar störst roll är att företagsnamnet återkommer i liknande sammanhang över tid. När modeller ser samma namn kopplat till ett visst område lär de sig att företaget hör dit.

Det är detta som kallas entity frequency, och det gör det enklare för modeller att förstå vilket ämne företaget ska kopplas till.

Så skapar du GEO-optimerat innehåll

GEO-optimerat innehåll ska vara enkelt för modeller att plocka isär. Varje stycke bör kunna lyftas in som ett eget svar utan att tappa sammanhang.

Frågedrivna rubriker

Rubriker fungerar bättre när de speglar riktiga frågor användare ställer.

- I stället för "Våra metoder" fungerar rubriken "Hur implementeras GEO i befintligt innehåll?".

- I stället för "Fördelar" är "Varför fungerar GEO bättre än klassisk SEO i AI-svar?" ett bättre val.

Den här typen av rubriker matchar hur människor söker information i AI-verktyg. De gör också att modellen snabbt ser vad avsnittet handlar om.

Täckning av alla relevanta delar av ämnet

En GEO-anpassad text samlar alla viktiga delar av ämnet på en enda sida. Tänk igenom vilka frågor som brukar dyka upp och vilka förklaringar som behövs.

En komplett text brukar innehålla:

- definitioner

- varför ämnet är relevant

- hur arbetssätt och metoder fungerar

- vad som krävs för att komma i gång

- vanliga misstag

- relaterade begrepp

- exempel eller case

När allt detta finns samlat på samma sida får modellen en helhetsbild och använder innehållet oftare som källa.

Faktablock som är lätta att läsa

Ett GEO-vänligt stycke börjar med poängen direkt. Detaljer och exempel kommer efteråt. Det gör att modellen snabbt förstår vad stycket handlar om.

Exempel:

"Topical coverage är den starkaste faktorn i GEO. Sidor som går igenom ett ämne ordentligt och tar med flera närliggande frågor används oftare som källa. Kortare texter som bara svarar på en enskild fråga fungerar i Google men väljs mer sällan av AI-modeller."

Strukturen är tydlig: poängen först, sedan förklaring.

Variation i språk

Språklig variation gör det enklare för AI-modeller att förstå bredden i texten. Undvik att använda samma ord hela tiden. Om innehållet handlar om content marketing kan du naturligt variera med uttryck som "innehållsmarknadsföring" eller "contentarbete" när det passar.

Variation visar för modellen att texten täcker ämnet bredare och hjälper den att koppla innehållet till fler typer av frågor. Det gör också strukturen tydligare eftersom modellen inte fastnar vid en enda formulering.

Stycken som fungerar fristående

Varje stycke bör ge mening även om läsaren hoppar rakt in i mitten av texten. Det gör att modellen kan plocka upp ett enskilt stycke och ändå få ett fungerande svar.

Det innebär:

- viktiga ord och uttryck förklaras när de behövs

- stycken startar med en tydlig poäng

- inga viktiga detaljer göms i lång text

- svar presenteras direkt i stället för att byggas upp sent

En text som fungerar på det här sättet är mycket enklare för modeller att citera.

Så arbetar Viseo med GEO

AI-optimering är en viktig del av vårt arbete. GEO används i hur vi planerar, skriver och utvärderar innehåll. Vi fokuserar på struktur, ämnesanalys och testning i flera modeller för att se hur våra texter faktiskt används i AI-svar.

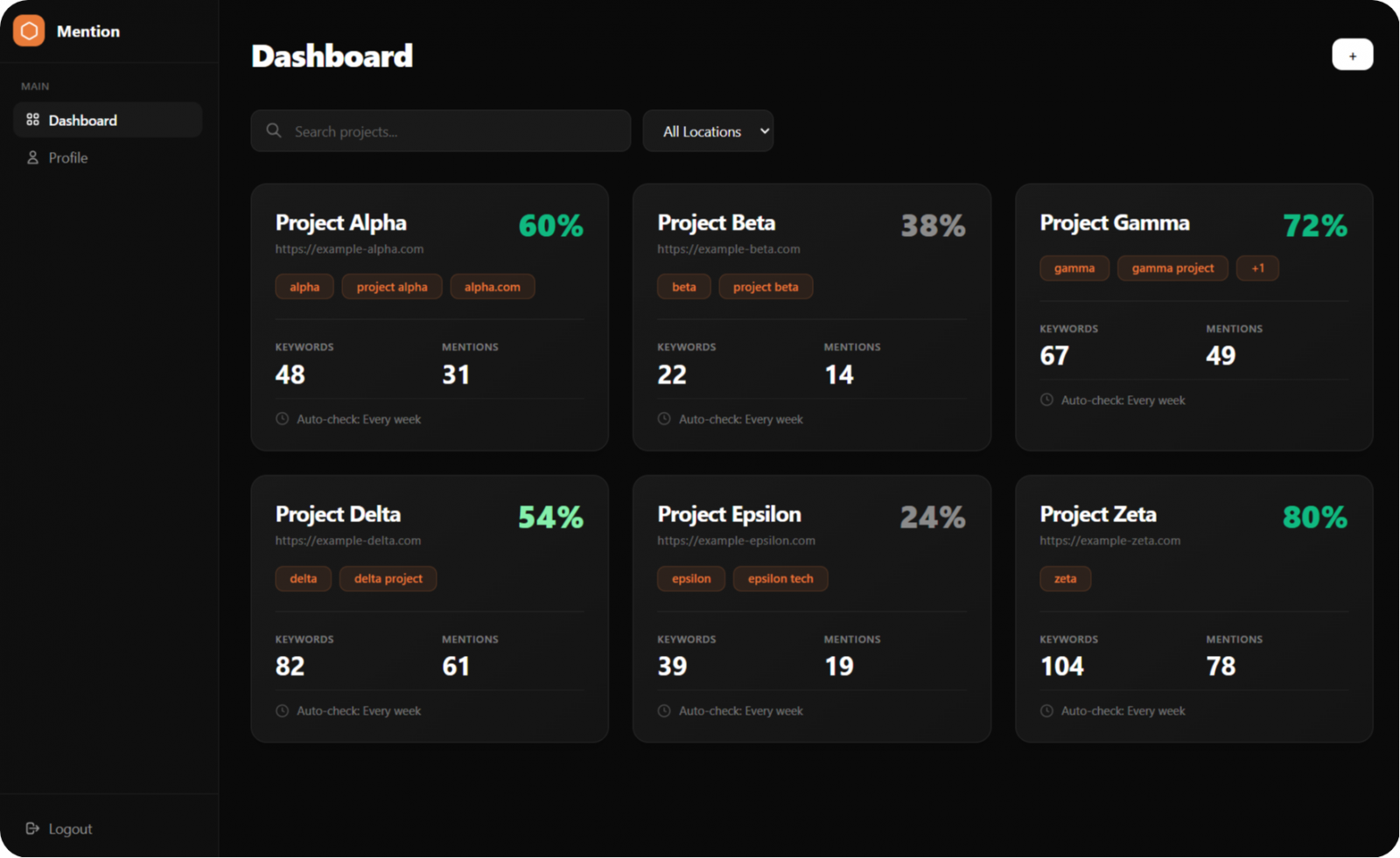

För att kunna mäta resultaten har vi byggt Mention, vårt eget verktyg som visar hur ofta sidor och varumärken nämns av dagens stora modeller. Det gör att vi snabbt ser vad som fungerar och vad som behöver förbättras.

Ämneskartläggning och klustring

När vi börjar med ett nytt ämne ser vi först till att förstå helheten. Vi går igenom vilka frågor användare ställer i Google Search Console, Ahrefs och andra verktyg, vad som återkommer i modellernas svar och vilken information som behövs för att täcka området ordentligt.

När bilden är klar delar vi upp allt i kluster (topical clusters). Ett kluster är ett område där alla delar hör ihop och bör finnas på samma sida för att både användare och modeller ska få en tydlig och komplett bild.

Vanliga typer av kluster:

- Grunder och definitioner

- vad är X

- centrala begrepp

- när och varför används det

- Arbetssätt och processer

- hur gör man

- steg för att komma igång

- vilka delar ingår i processen

- Strategi och användning

- när det fungerar bra

- vilka problem det löser

- praktiska exempel

- Vanliga problem

- missförstånd

- felaktiga antaganden

- orsaker till att resultat uteblir

- Jämförelser

- skillnader mellan två arbetssätt

- vilka val som är vanligast och varför

När allt detta samlas i samma cluster kan vi skriva texter som täcker ämnet på ett tydligt sätt. Det gör att modeller inte behöver leta på flera sidor och att användare får en helhetsbild direkt, utan att hoppa runt mellan olika artiklar.

Struktur som modeller kan läsa

När strukturen sätts ser vi till att rubriker, stycken och definitioner är enkla att tolka. Rubriker formuleras som frågor eller tydliga ämnen. Varje stycke börjar med huvudpoängen och fylls sedan på med exempel eller förklaringar.

Vi undviker långa inledningar. Det viktigaste kommer tidigt, och bold används sparsamt för ord som modellen behöver hitta snabbt.

Målet är att varje del av texten ska gå att lyfta in i ett AI-svar utan att tappa betydelse.

Vi testar flera modeller

När innehållet är klart testar vi det i flera LLM:er. Vi varierar våra prompts för att se hur modellerna hämtar och använder informationen.

Vi ställer också samma fråga på olika sätt. Det visar om texten fungerar oavsett formulering eller om den bara plockas upp vid exakta matchningar.

Det gör det enklare att se om strukturen är tillräckligt tydlig eller om något behöver justeras.

Övervakning med vårt eget verktyg

Med Mention följer vi hur ofta varumärken, ämnen och enskilda sidor nämns i modeller som ChatGPT, Claude, Gemini och Perplexity.

Vi ser tidigt när något förändras. Om en konkurrent nämns oftare analyserar vi varför. Om ett ämne tappar synlighet förstärker vi innehållet direkt.

På så sätt arbetar vi löpande med AI-synlighet, inte bara med traditionell SEO.

Vanliga misstag inom GEO

Det finns några mönster som ofta gör att innehåll presterar sämre i AI-svar. De är lätta att undvika när man vet vad man ska titta efter.

- Korta (eller "tunna") artiklar – att bara besvara en enskild fråga i stället för att täcka hela ämnet.

- Otydliga rubriker – kreativa eller säljiga rubriker som inte visar vad avsnittet handlar om.

- För stort fokus på schema – att prioritera schema markup när det inte påverkar AI-modellernas källval.

- För långa textblock – stycken som blir svåra för modeller att plocka isär och använda i svar.

- För lite variation i språket – att upprepa samma termer i stället för att använda synonymer och relaterade ord.

- Att tro att länkar styr GEO – backlinks påverkar Google, men inte AI-modeller på samma sätt.

Checklista för GEO-optimering

Relationen mellan SEO och GEO

GEO bygger på samma grundprinciper som klassisk on-page SEO. Tydliga rubriker, bra struktur och ett innehåll som täcker ämnet ordentligt fungerar i båda fallen. Skillnaden ligger i vad du optimerar för. SEO fokuserar på placeringar i sökresultat, medan GEO handlar om att bli den källa som AI-modeller använder när de formulerar sina svar.

I SEO kan informationen vara fördelad över flera undersidor och det finns ofta utrymme för mer kreativt språk. I GEO behöver allt centralt finnas samlat på en sida och presenteras på ett sätt som gör det enkelt för modeller att plocka ut relevanta delar. Där SEO fortfarande lägger stor vikt vid backlinks tittar GEO mer på faktisk användning, trafik och hur lätt innehållet går att läsa och extrahera.

Det är inte två motsatta metoder - Tvärtom brukar innehåll som är bra för GEO också fungera i SEO. En tydlig struktur, bred täckning och raka rubriker uppskattas av både sökmotorer och AI-modeller.

Det viktigaste är att anpassa sig till hur användare söker information idag. När fler får sina svar direkt i AI-verktyg behöver innehållet vara optimerat för att synas där - inte enbart i ett traditionellt sökresultat.

Vanliga frågor & svar

Vad är GEO?

GEO betyder Generative Engine Optimization och handlar om att göra innehåll lätt för AI-modeller att läsa, tolka och använda som källa. Fokus ligger på tydliga rubriker, korta stycken och att samla allt viktigt på samma sida så modellen snabbt förstår vad texten innehåller.

Hur fungerar AI-sökresultat?

När någon ställer en fråga i ChatGPT, Gemini, Claude eller Perplexity söker modellen efter texter som ger enkla svar. Den analyserar rubriker, stycken och hur informationen är uppbyggd. Modellen väljer bara ett fåtal källor som den bygger sitt svar på.

Kan ChatGPT rekommendera mitt företag?

Ja, men bara om modellen uppfattar företaget som kopplat till ämnet. Det beror på hur ofta företagsnamnet nämns i relevanta sammanhang och hur tydlig kopplingen är i det material modellen tränas på. Detta kallas entity frequency och har större betydelse än länkar.

Behöver hela sajten optimeras för GEO?

Nej. Det räcker att börja med sidor som är viktiga för varumärket, förklarar centrala ämnen eller används som informationssidor. GEO har störst effekt på guider, artiklar och innehåll som besvarar frågor.

Hur påverkar GEO min trafik?

Trafiken kan komma i färre klick men med högre relevans. Målet är att synas i själva svaret, inte bara i ett sökresultat. När modeller använder en sida som källa ökar chansen att användaren söker upp företaget direkt.

Hur ofta behöver man uppdatera ett GEO-optimerat innehåll?

Inte lika ofta som vid SEO. Det viktigaste är att innehållet är tydligt, aktuellt och samlat. Uppdatera när ämnet ändras eller när nya frågor börjar dyka upp.

Kan GEO kombineras med annan digital marknadsföring?

Ja. GEO fungerar ihop med SEO, Google Ads, CRO och övriga strategier. Det är ett sätt att förstärka innehållsstrategin, inte ersätta andra metoder.

Hur vet jag om mitt innehåll fungerar i AI-modeller?

Synlighet går att mäta. Med vårt verktyg Mention ser vi hur ofta sidor och varumärken nämns i modeller som ChatGPT, Claude, Gemini och Perplexity. Det gör det enkelt att följa utvecklingen och se vilka ändringar som ger effekt.

Se hur din hemsida presterar i AI-sök

Få en snabb analys av hur modeller som ChatGPT, Gemini och Perplexity tolkar ditt innehåll.

Axel Hansson

Jobbar som Head of SEO på Viseo. Arbetat med sökmotoroptimering i snart 15 år och älskar att fokusera mig på den tekniska biten.